AI项目和框架

- [推荐] 豆包网页版:支持AI聊天,AI图片生成,AI漫画生成,AI写作等

字节跳动开发的一款多功能人工智能工具,基于云雀模型(豆包大模型)构建。它不仅是一个AI聊天机器人,还具备多种功能,包括写作助手、英语学习助手、音乐生成、编程助理等。

- ChatClaw官网:智麻开源轻量型类OpenClaw个人AI智能体

ChatClaw是由zhimaAi开源的类OpenClaw个人AI智能体,仅30MB超小安装包,兼容macOS/Windows/Linux全平台。产品内置本地知识库、技能市场、MCP扩展、长期记忆与计划任务能力,可一键接入钉钉、飞书、企业微信、QQ等10+通讯平台。

- Molili官网 - 当贝出品·OpenClaw中文版AI数字员工

支持通过微信、钉钉、飞书、Siri多平台远程操控电脑,可自动完成报表整理、文档处理、社交媒体运营等办公任务。内置8000+技能的Skill商店,支持自由组合专属工作流,全面释放自动化生产力。

- seedance2.plus官网 - 将文本或图像转化为电影级AI视频

Seedance 2.0是一款全新一代AI视频生成工具,可通过文本提示或图像直接生成高逼真度电影级视频。产品依托双分支DiT架构技术,可同步生成视觉画面、人物对话与配套音频效果,从根源上解决传统AI视频工具需大量后期制作的痛点。

- Nemotron-Cascade 2模型官网 - 英伟达正式开源的MoE混合专家模型,总参数量达30B

Nemotron-Cascade 2是英伟达正式开源的混合专家模型(MoE),总参数量达30B,而激活参数仅3B,实现了“轻体量”与“高性能”的完美平衡。尽管体量轻巧,它却在硬核推理领域展现出惊人爆发力。

- DetectMy官网 - 精准识别文本为完全AI生成、部分AI生成或人类创作

AI Detector是一款免费在线工具,该工具应运而生,主打快速、安全、无需注册的核心优势,可提供句级分析与清晰解释,定位为辅助用户判断文本来源的实用工具,全程免费使用,适配多场景检测需求。

- gstack官网 - 浏览器自动化、双AI交叉审查、自动文档更新等核心能力

全部通过斜杠命令调用,支持并行运行10-15个Sprint,具备真实浏览器自动化、双AI交叉审查、自动文档更新等核心能力,高效提升编程全流程效率。

- GPTVerify官网 - 精准区分AI生成、AI改写与人类撰写的内容

GPTVerify是一款免费AI检测工具,采用多层分析方法解读多种语言信号,对多数常见内容类型评估可靠;句子级分类+具体解释,透明度与可解释性拉满;可精准识别AI改写的混合特征文本。

- FlowChart AI官网 - 自动转换为专业可编辑的流程图、思维导图、分析图

无需任何设计技能,支持文本、PDF、Word、PPT、电子表格、图像等多种输入源,且具备实时协作功能。产品定位为个人与团队专属高效图表生成工具,目前可免费使用,适配多场景图表制作需求。

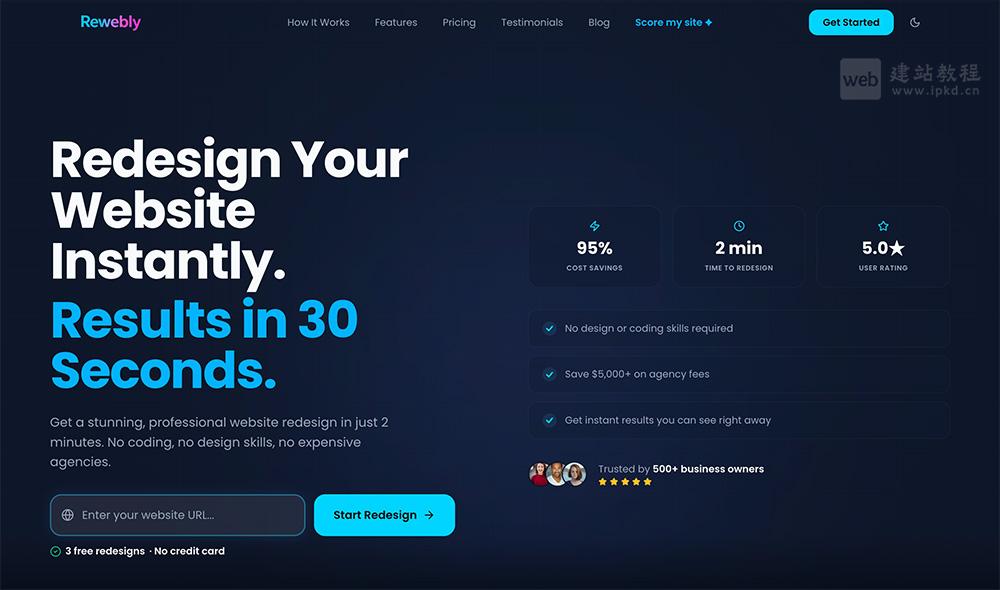

- Rewebly官网 - 快速、轻松地完成现有网站的现代化改造

Rewebly是一款基于人工智能的网站重新设计工具,致力于帮助用户快速、轻松地完成现有网站的现代化改造。它打破了传统网站设计对专业技能和高昂成本的限制,让普通用户也能轻松拥有专业级网站设计。

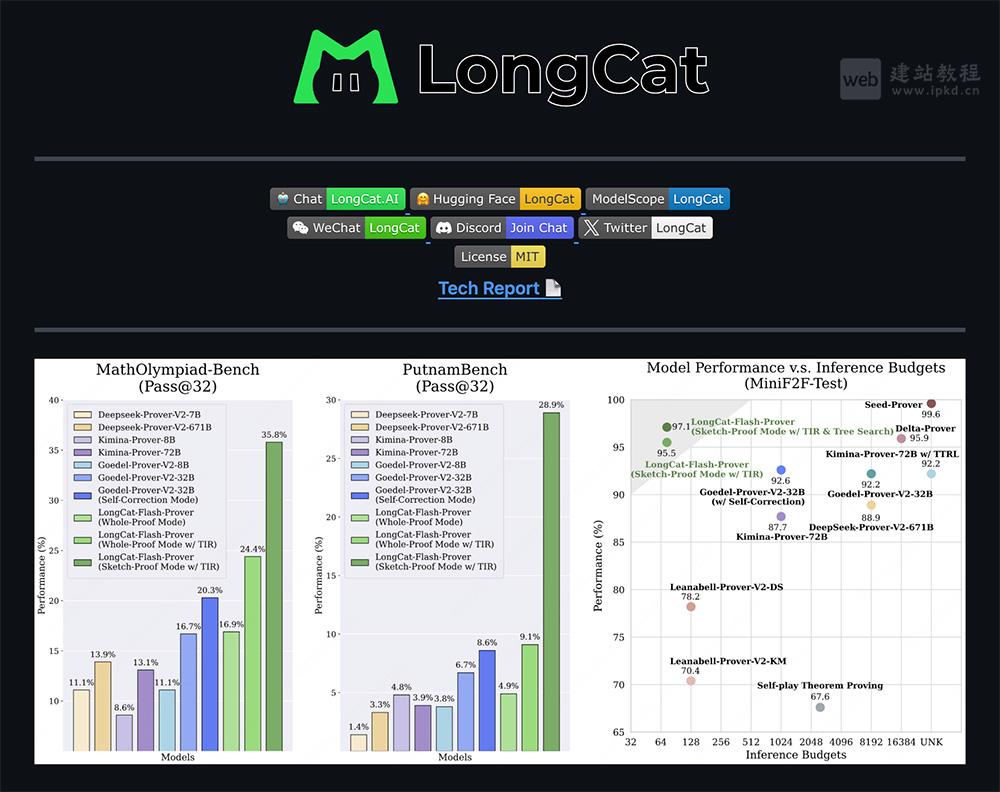

- LongCat-Flash-Prover模型官网 - 美团开源的5600亿参数MoE形式化数学推理模型

采用混合专家迭代框架与HisPO强化学习算法稳定训练,引入防作弊机制保障推理严谨性,在MiniF2F-Test等基准测试中达成SOTA水平,Pass@32准确率93.9%、PutnamBench难题解决率28.9%,显著超越现有开源模型。

- 聚合API官网 - 提供高质量AI接口服务,兼容300+领先AI模型

聚合API提供高质量AI接口服务,兼容300+领先AI模型(含国际领先与国内顶尖型号),具备企业级安全加密、智能负载均衡等优势,确保服务安全稳定、低延迟(平均响应≤100ms)、高并发,价格透明且极具竞争力,适配各类企业、开发者及研究机构,助力用户通过AI提升生产力、拓展业务创新。

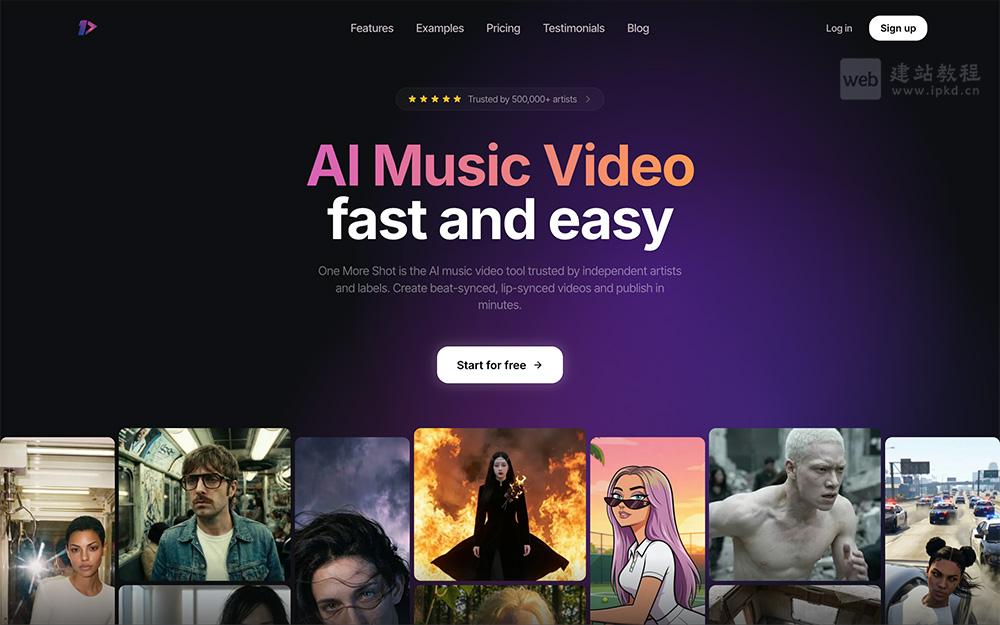

- One More Shot官网 - 上传歌曲后AI几分钟内即可完成完整音乐视频制作

One More Shot是一款革命性AI音乐视频生成工具,专为独立艺术家、音乐制作人及内容创作者打造,无需视频编辑经验,上传音频、选择风格,AI几分钟内即可生成与音乐节奏、情感匹配的高质量视觉效果,比传统制作便宜100倍,高效节省时间成本。

- 智谱GLM-Claw官网 - 基于GLM‑5‑Turbo模型推出的云端部署OpenClaw智能体

GLM‑Claw是智谱基于GLM‑5‑Turbo模型推出的云端部署OpenClaw智能体,支持多智能体并行驱动与分工协作,可一站式完成调研、编码、审查等全流程工作,支持通过智谱清言、OpenClaw框架及飞书等平台接入,用户仅需使用自然语言指令,即可实现各类任务自动化。

- helloGPT官网使用入口,内置智能情感表达功能,让翻译与对话更具人性化

HelloGPT是一款面向整个组织的对话智能平台,可无缝融入现有工作流程,核心聚焦跨境电商等场景,提供高品质智能翻译服务。依托先进人工智能对话技术,它在语法精准度、语言习惯贴合度及情感表达上表现出众,能够帮助用户打破语言壁垒,高效推进跨境业务。

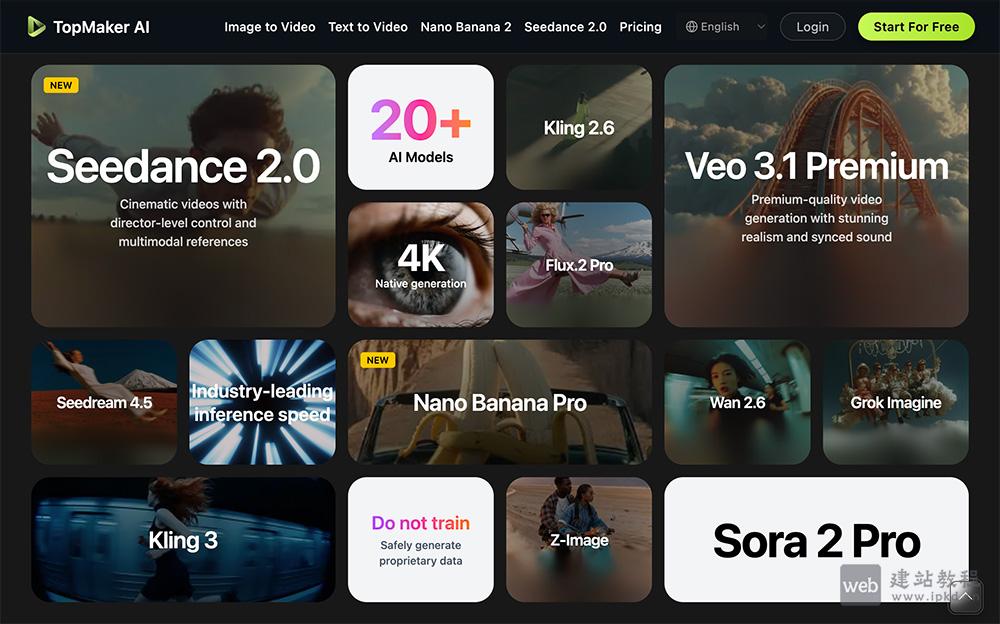

- TopMaker AI官网使用入口,整合Seedance 2.0、Sora 2等20多种先进AI模型

TopMaker AI是一款一体化AI图像与视频创作平台,整合Seedance 2.0、Sora 2等20多种先进AI模型,将文本/图像输入、内容生成、编辑优化融为一体,为创作者提供便捷高效的视觉内容创作解决方案。