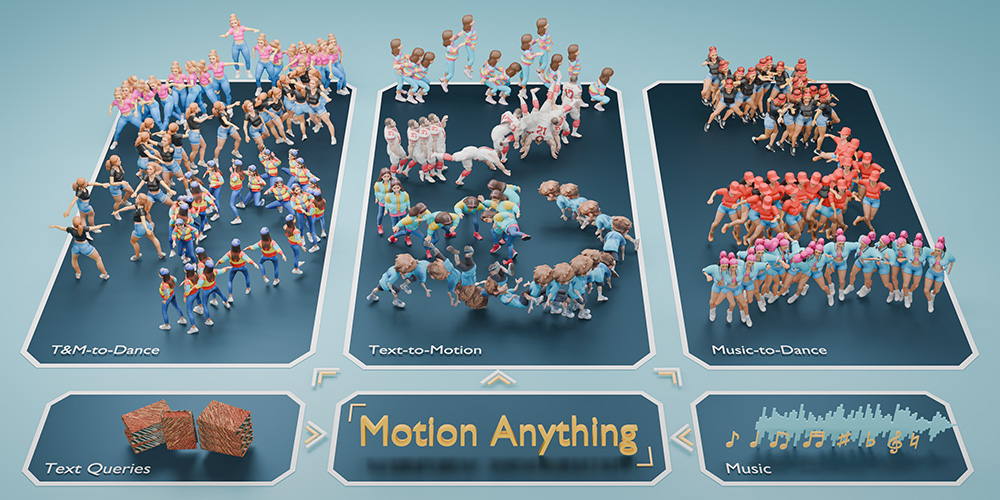

MotionAnything是由澳大利亚国立大学、悉尼大学、腾讯、麦吉尔大学、京东等机构联合推出的一个多模态运动生成框架。它能够根据文本描述、音乐或两者的组合生成高质量、可控的人类运动。该框架引入了基于注意力的掩码建模方法,实现了对运动序列中关键帧和动作的细粒度控制。

MotionAnything功能特点:

1、多模态条件下的运动生成:

支持根据文本描述、音乐或两者的组合生成高质量的人类运动。

2、细粒度控制:

基于注意力机制,对运动的关键帧和动作进行细粒度控制,实现更精准的生成效果。

3、动态优先级调整:

根据给定条件(如文本或音乐)动态调整运动生成的优先级,优先生成与条件最相关的动态帧和身体部位。

4、跨模态对齐:

将文本、音乐和运动在时间和空间维度上进行有效对齐,提升生成运动的连贯性和一致性。

5、时间自适应变换器:

根据条件的模态(文本、音乐或两者的组合),动态调整注意力计算。让运动的关键帧与文本中的关键词或音乐的节拍对齐,提升时间维度上的连贯性。

6、空间对齐变换器:

将条件和运动嵌入重新排列,暴露空间维度。恢复被掩码的关键动作,确保运动与条件在空间上的一致性。

7、多模态条件编码:

同时处理文本和音乐等多种模态条件,基于自适应编码器将不同模态的信息整合到运动生成中。

8、数据集支持:

提供新的Text-Music-Dance(TMD)数据集,包含2153对文本、音乐和舞蹈的配对样本,为多模态运动生成提供丰富的数据支持。

MotionAnything应用场景:

1、影视动画:

快速生成高质量动画,减少制作成本,提升视觉效果。

2、VR/AR:

为虚拟角色生成逼真动作,增强沉浸感,实现自然交互。

3、游戏开发:

根据剧情或音乐生成角色动作,提升游戏的趣味性和流畅性。

4、人机交互:

生成自然动作,让机器人与人类交互更友好,实现语音指令驱动的动作生成。

5、教育与培训:

生成标准动作示范,辅助体育、舞蹈等教学,提升培训效果。

相关阅读文章

Ardot官网使用入口,腾讯推出的支持文生UI、图转设计等功能

HY Motion模型使用入口,腾讯推出的开源文本到3D动作AI模型

CL-bench:腾讯混元与复旦大学联合推出的Context学习能力评测基准

Vemus未音:腾讯音乐首款一站式AI音乐创作工具 0门槛实现人人玩音乐

上面是“一款由腾讯京东悉尼大学等机构联合推出的多模态运动生成框架——Motion Anything”的全面内容,想了解更多关于 IT知识 内容,请继续关注web建站教程。

当前网址:https://ipkd.cn/webs_18414.html

声明:本站提供的所有资源部分来自互联网,如果有侵犯您的版权或其他权益,请发送到邮箱:admin@ipkd.cn,我们会在看到邮件的第一时间内为您处理!