Engram是由DeepSeek团队与北京大学联合推出的条件记忆模块,专为提升大语言模型(LLM)核心性能而生。它创新性引入现代化 *n*-gram 嵌入表,将静态知识独立存储于专属内存空间,结合稀疏检索与上下文感知门控技术实现高效知识调用;同时与混合专家模型(MoE)形成互补,在不增加计算量的前提下,显著强化模型在知识密集型任务、长上下文处理与复杂推理中的表现,更能突破 GPU 显存限制,支持大规模参数扩展。

Engram核心功能:

1、高效知识检索,降低资源依赖:

依托独立的静态嵌入表,快速精准查找固定知识与事实性信息,无需模型重复计算推导,大幅减少对计算资源的占用,提升响应效率。

2、优化长上下文处理,增强全局推理能力:

释放注意力机制的算力占用,使其专注于长文本的全局逻辑关联分析,有效解决大模型处理超长文本时的性能衰减问题,提升长文本推理的准确性。

3、计算存储解耦,突破显存瓶颈:

支持从主机内存异步预取数据,打破 GPU 显存对模型参数规模的限制,为大模型向更大参数量级扩展提供底层技术支撑。

4、零额外计算量,多任务性能跃升:

在不增加模型推理计算量的前提下,全面提升知识问答、通用推理、代码生成、数学解题等任务的表现,实现性能与效率的双重优化。

Engram核心技术原理:

1、分词器压缩:提升词表利用效率:

通过预计算的满射函数,将原始 Token ID 映射为规范化 ID,剔除词表冗余信息,扩大 *n*-gram 序列的覆盖范围,提升嵌入表的检索精准度与效率。

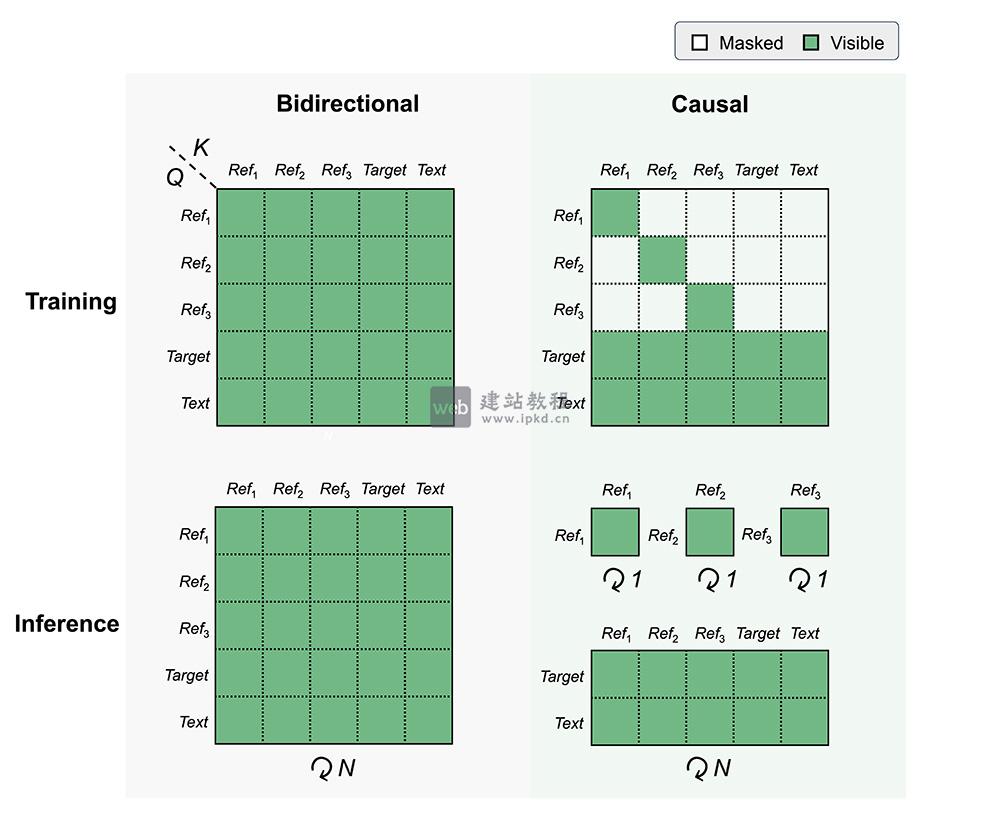

2、多头哈希检索:破解组合参数化难题:

采用哈希方法结合多头机制,将局部上下文特征映射至嵌入表,有效解决直接参数化海量 *n*-gram 组合的技术难题,实现高效的上下文匹配。

3、上下文感知门控:保障语义一致性:

以模型当前隐藏状态作为动态 Query,将检索到的嵌入向量作为 Key 和 Value,通过门控机制智能过滤噪声信息,确保检索知识与当前上下文语义高度契合。

4、稀疏性参数分配:挖掘最优性能平衡点:

在固定参数预算内,重新分配 MoE 专家参数与 Engram 内存参数占比,基于计算与记忆的 U 型权衡曲线,找到参数分配的最优比例,实现性能最大化。

5、系统级优化:掩盖数据传输延迟:

利用 Engram 检索的确定性特性,设计数据预取与计算重叠机制,有效掩盖主机内存与 GPU 之间的数据传输延迟,保障模型推理的流畅性。

Engram典型应用场景:

1、智能知识问答:

快速检索知识库中的事实性信息,为问答系统提供精准答案支撑,提升响应速度与准确性,适用于智能客服、知识库问答等场景。

2、高质量文本生成:

高效匹配文本生成所需的固定短语、句式模式与专业术语,优化生成内容的流畅度与专业性,适用于文案创作、报告撰写等场景。

3、长文本深度分析:

优化法律文书、学术论文、行业报告等超长文本的处理能力,精准提取核心观点、梳理逻辑脉络,适用于法律分析、学术研究等领域。

4、代码开发辅助:

快速检索代码中的常见算法结构、语法模式与最佳实践,提升代码生成、补全与纠错的效率,助力开发者高效完成编程任务。

5、复杂数学推理:

精准调取数学公式、定理与解题方法,辅助模型完成复杂数学问题的推导与求解,适用于教育辅导、科学计算等场景。

相关阅读文章

ZenMux:全球首个搭载保险赔付机制的企业级AI大模型聚合平台

Lorka AI:汇聚GPT、Gemini、DeepSeek等于一体的多模型聚合人工智能平台

Open-o3 Video:北京大学与字节跳动联合研发的开源视频推理模型

上面是“Engram:DeepSeek × 北大联合研发,赋能大模型的高效条件记忆模块”的全面内容,想了解更多关于 AI项目和框架 内容,请继续关注web建站教程。

当前网址:https://ipkd.cn/webs_27251.html

声明:本站提供的所有资源部分来自互联网,如果有侵犯您的版权或其他权益,请发送到邮箱:admin@ipkd.cn,我们会在看到邮件的第一时间内为您处理!