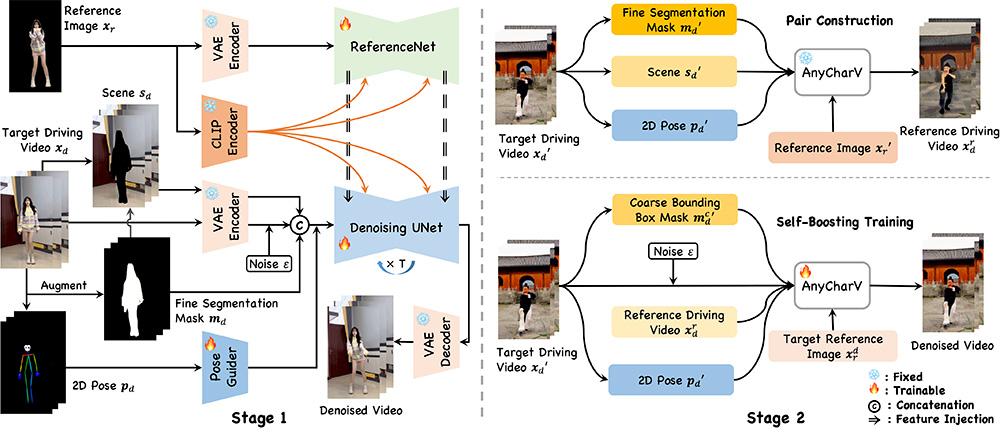

AnyCharV是由香港中文大学、清华大学深圳国际研究生院和香港大学联合推出的角色可控视频生成框架。它能够将任意参考角色图像与目标驱动视频相结合,生成高质量的角色视频。该框架于2025年2月12日发布。

AnyCharV的功能特点:

1、任意角色与目标场景的合成:可以将任意给定的角色图像与目标驱动视频结合,生成自然、高质量的视频。

2、高保真角色细节保留:

– 基于自增强训练和粗粒度掩码引导,保留角色的外观和细节,避免失真。

– 引入参考图像的多路径特征注入(如CLIP编码器和ReferenceNet),确保角色外观和身份的高保真度。

– 通过自增强训练和粗掩码引导,显著减少生成视频中的模糊和伪影。

3、复杂场景与人-物交互:支持角色在复杂背景下的自然交互,如运动、物体操作等。

4、灵活的输入支持:结合文本到图像(T2I)和文本到视频(T2V)模型生成的内容,具有很强的泛化能力。

5、高效生成与广泛兼容性:

– 生成效率高,仅需5分钟即可生成5秒的24FPS视频。

– 支持与文本到图像(T2I)、文本到视频(T2V)模型生成的内容结合。

AnyCharV的应用场景:

1、影视制作:将任意角色合成到目标场景,支持复杂交互,助力特效制作。

2、艺术创作:结合文本生成内容,快速生成高质量角色视频,激发创意。

3、虚拟现实:实时生成角色与虚拟场景的交互视频,增强沉浸感。

4、广告营销:快速合成个性化广告视频,满足多样化需求。

5、教育培训:生成特定角色和场景的视频,辅助教学和培训。

AnyCharV项目地址:

1、项目官网:https://anycharv.github.io/

2、GitHub仓库:https://github.com/AnyCharV/AnyCharV

3、arXiv技术论文:https://arxiv.org/pdf/2502.08189

相关阅读文章

EdgeClaw AI智能体框架使用入口,面壁智能联合清华、OpenBMB等机构推出的开源AI智能体框架

OpenMAIC官网使用入口,清华THU MAIC研发的开源AI互动教育平台

OpenMAIC官网使用入口,清华团队开源的多智能体AI课堂平台

CLI-Anything模型使用入口,让任意软件一键变成AI Agent原生CLI工具

DreamID-Omni虚拟数字人模型,清华 × 字节跳动统一可控以人为中心音视频生成框架

上面是“AnyCharV :一款由香港大学联合清华大学等机构推出的角色可控视频生成框架”的全面内容,想了解更多关于 IT知识 内容,请继续关注web建站教程。

当前网址:https://ipkd.cn/webs_17217.html

声明:本站提供的所有资源部分来自互联网,如果有侵犯您的版权或其他权益,请发送到邮箱:admin@ipkd.cn,我们会在看到邮件的第一时间内为您处理!