视频生成模型

- LTX-2.3视频生成模型使用入口,拥有220亿参数,最高可输出4K分辨率

LTX-2.3是以色列AI公司Lightricks开源的新一代视频生成模型,模型支持文本、图像、音频三模态输入,最高可输出4K分辨率,原生适配9:16竖屏与24/48FPS帧率,通过全新VAE架构显著提升画面细节与音画同步能力,搭配LoRA微调与本地工具生态,为全场景视频创作提供高效解决方案。

- [推荐] 豆包网页版:支持AI聊天,AI图片生成,AI漫画生成,AI写作等

字节跳动开发的一款多功能人工智能工具,基于云雀模型(豆包大模型)构建。它不仅是一个AI聊天机器人,还具备多种功能,包括写作助手、英语学习助手、音乐生成、编程助理等。

- SkyReels-V3:昆仑万维开源多模态视频生成模型,专业级全模态视频创作

模型支持静态图像转动态影像、智能视频时长延长、电影级专业转场,更能实现数字人音视频精准同步,为创作者打造从短片段到长叙事的一站式视频生成解决方案,全方位适配商业创作、内容生产、行业应用等多元视频需求。

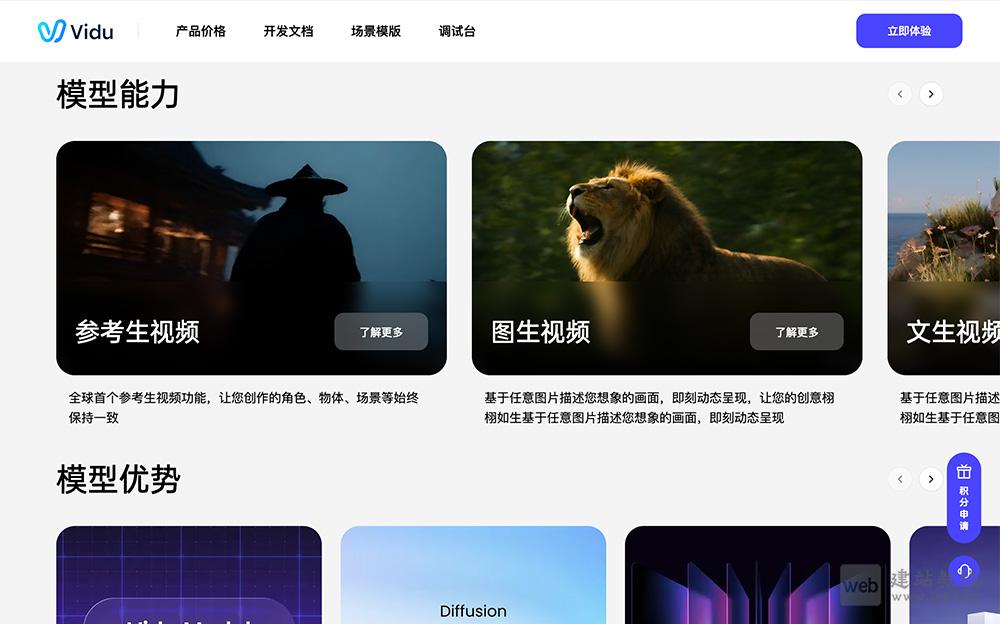

- Vidu Q2参考生Pro:一键复刻人物表情、复杂动作、特效画面等

Vidu Q2参考生Pro是全球首创的「万物可参考」生产级视频生成模型,创新性支持多模态素材输入,赋能创作者一键复刻人物表情、复杂动作、特效画面、场景氛围与纹理细节,实现视频内容的精细化编辑。

- UniVG:百度团队研发的AI视频生成系统,支持文本、图像组合输入

UniVG是百度团队研发的多条件驱动统一AI视频生成系统,核心突破在于支持文本、图像的任意组合输入,可灵活适配不同自由度的视频生成需求,有效解决传统视频生成模型仅能处理单一任务、单一输入的局限性。

- Vidi2:字节跳动多模态大语言模型,赋能视频理解与智能创作

Vidi2是字节跳动推出的专注于视频理解与创作的多模态大语言模型,模型可基于文本查询,精准识别视频对应时间戳并标记目标对象边界框,还创新引入VUE-STG、VUE-TR-V2两大基准测试,为STG能力评估提供更科学的标准。

- 可灵O1:可灵AI推出的全球首款统一多模态视频生成模型

可灵O1是可灵AI研发的全球首个统一多模态视频生成模型,模型支持图片、视频、文字等多模态输入,可一站式完成全能创作与编辑,精准解决视频生成中的主体一致性难题,解锁多元创意组合玩法。

- HunyuanVideo 1.5:腾讯混元团队推出的开源轻量级视频生成模型

HunyuanVideo 1.5是腾讯混元团队推出的开源轻量级视频生成模型,模型支持文生视频、图生视频双模式生成5-10秒高清内容,具备强大的指令理解能力,可精准复刻写实、动画等多元视觉风格。

- InfinityStar:字节跳动推出的高效开源视频生成模型

InfinityStar是字节跳动推出的高效视频生成模型,该模型支持文本到图像、文本到视频、图像到视频及长时间交互视频合成等多类任务,且所有代码与模型均已开源。

- Kandinsky 5.0:俄罗斯AI-Forever实验室旗舰文本到视频生成模型

Kandinsky 5.0是俄罗斯AI研究实验室AI-Forever研发的新一代文本到视频生成模型,兼具卓越生成质量与高效推理性能,在跨场景内容创作中展现出强劲竞争力。

- Imagine v0.9:xAI重磅发布,20秒生成电影感视频的高效创作工具

Imagine v0.9是xAI公司推出的新一代视频生成模型,该模型可在20秒内生成6秒左右的高质量视频,支持精准运动控制、动态相机特效、自然对话与歌声合成,更配备语音优先交互界面,用户通过语音指令即可快速完成创作。

- MotionAgent:全链路AI视频创作工具,从剧本到成片一键生成

MotionAgent是一款端到端的深度学习模型工具,它整合了多模态AI模型的能力,为用户提供剧本创作、剧照生成、图生视频、背景音乐谱写的一站式创作流程,让创意无需专业技能即可轻松落地为可视化视频内容。

- 阿里EMO:阿里巴巴智能计算研究院开发的一款创新AI视频生成框架

用户只需提供一张静态照片和一段音频文件,即可生成与音频内容高度匹配的动态视频。这些视频不仅包含丰富的表情变化,还具有真实的头部动作。

- Character-3模型:一款由Hedra Studio推出的AI数字人视频生成模型

Character-3是由Hedra Studio推出的多模态AI数字人模型,能够将图像、文本和音频联合推理,生成栩栩如生的动态角色视频。它支持全身动作捕捉、情感控制和多样化角色生成,可快速制作高质量视频。

- 一款由阿里通义万相视频生成AI大模型——WanX 2.1

阿里通义万相视频生成模型WanX 2.1凭借其强大的技术实力和广泛的应用场景,已成为视频生成领域的领先工具,为用户提供了前所未有的创作体验。

- 视频生成模型svd_xt_1_1.safetensors简单介绍

svd_xt_1_1.safetensors是一个基于safetensors格式的视频生成模型,适用于将静态图像转换为视频,具有较高的生成质量和帧率。用户可以通过多种途径获取该模型,并在满足一定硬件和软件配置要求的情况下进行使用。