多模态AI模型

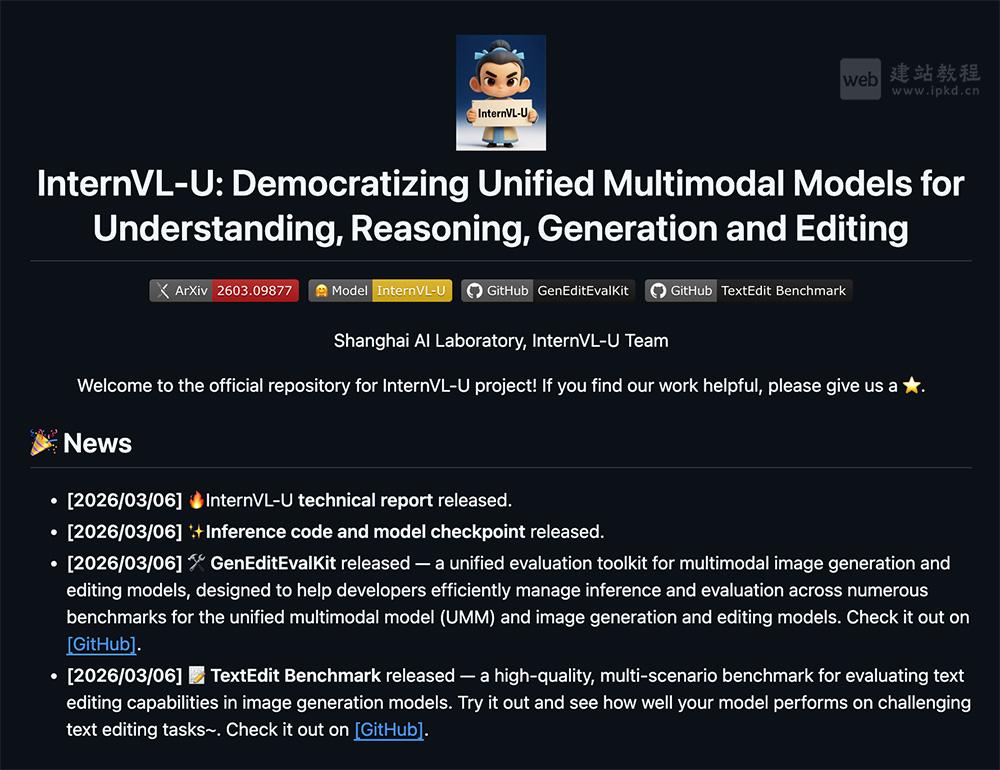

- InternVL-U模型使用入口,4B参数轻量化统一多模态模型

InternVL-U是上海人工智能实验室联合多所顶尖高校开源的4B参数轻量化统一多模态模型,模型依托“统一语境建模+模态专用模块化+解耦视觉表征”三大核心设计,突破传统多模态模型训练成本高、能力不均衡的痛点。

- [推荐] 豆包网页版:支持AI聊天,AI图片生成,AI漫画生成,AI写作等

字节跳动开发的一款多功能人工智能工具,基于云雀模型(豆包大模型)构建。它不仅是一个AI聊天机器人,还具备多种功能,包括写作助手、英语学习助手、音乐生成、编程助理等。

- AIReel官网使用入口,一站式AI影片生成器文字、图片即刻转影片

产品精准匹配市场对快速视频制作的需求,相比传统手动创作可节省90%的时间与成本,适配视频创作者、企业营销人员、内容创作者、学生等全群体,是各类视频创作场景的高效工具。

- Qwen3.5模型使用入口,开源版本Qwen3.5-397B-A17B采用创新混合架构

Qwen3.5通过早期文本-视觉融合、M-RoPE及3D位置编码技术,统一支持文本、图像、视频多任务处理,语言覆盖从119种扩展至201种。权威评测中表现顶尖:MMLU-Pro得分87.8超越GPT-5.2,GPQA得分88.4高于Claude 4.5,IFBench指令遵循评分76.5刷新行业纪录。

- TeichAI官网使用入口,面向企业与开发者的一站式人工智能能力平台

TeichAI 定位为「企业级AI能力中台」,核心围绕大语言模型、多模态AI、行业定制化模型等方向,为用户提供从AI能力调用、模型微调、应用搭建到私有化部署的全链路服务:底层整合主流开源/闭源大模型,提供统一的API接口与可视化操作界面。

- Kimi k1.5:MoonshotAI研发的强化学习优化新一代多模态语言模型

Kimi k1.5是MoonshotAI研发的新一代多模态语言模型,依托强化学习优化与长上下文扩展核心技术,实现复杂推理任务性能的大幅提升,在AIME、MATH-500等权威数学推理基准测试中超越GPT-4o、Claude Sonnet 3.5,达到行业领先水平。

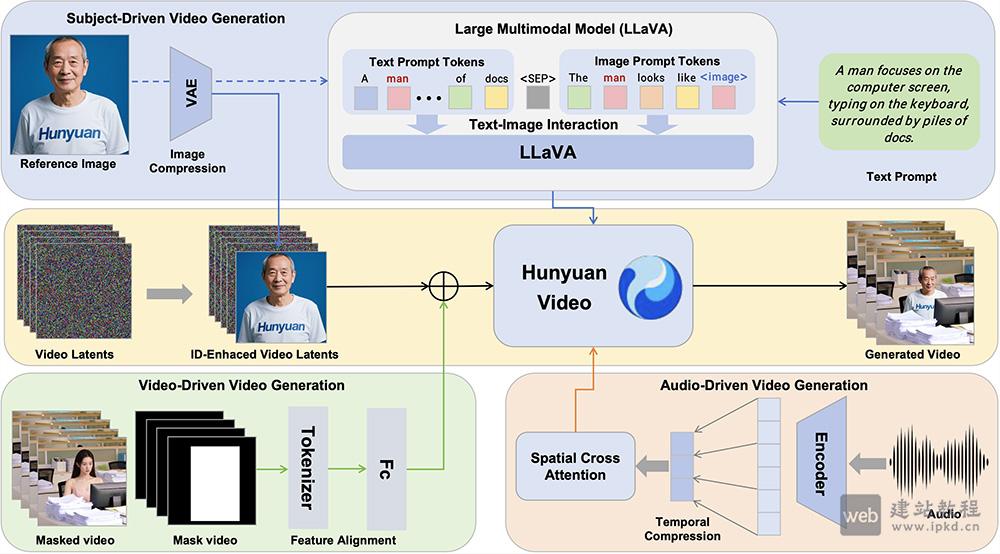

- HunyuanCustom:支持文本、图像、音频、视频多模态输入的多模态定制视频生成框架

HunyuanCustom是一款多模态定制视频生成框架,可根据用户自定义条件,精准生成特定主题的定制化视频。该框架在人物身份一致性上表现突出,全面支持文本、图像、音频、视频多模态输入,适配虚拟人广告制作、个性化视频编辑等多元应用场景,为创作者提供高效的视频定制解决方案。

- Intern-S1-Pro:上海AI实验室开源的万亿参数科学多模态大模型

Intern-S1-Pro是上海AI实验室开源的万亿参数科学多模态大模型,采用MoE混合专家架构,基于「通专融合」SAGE技术打造。模型通过傅里叶位置编码与重构时序编码器赋予独特「物理直觉」,可统一理解从微观生命信号到宏观宇宙波动的全尺度科学数据。

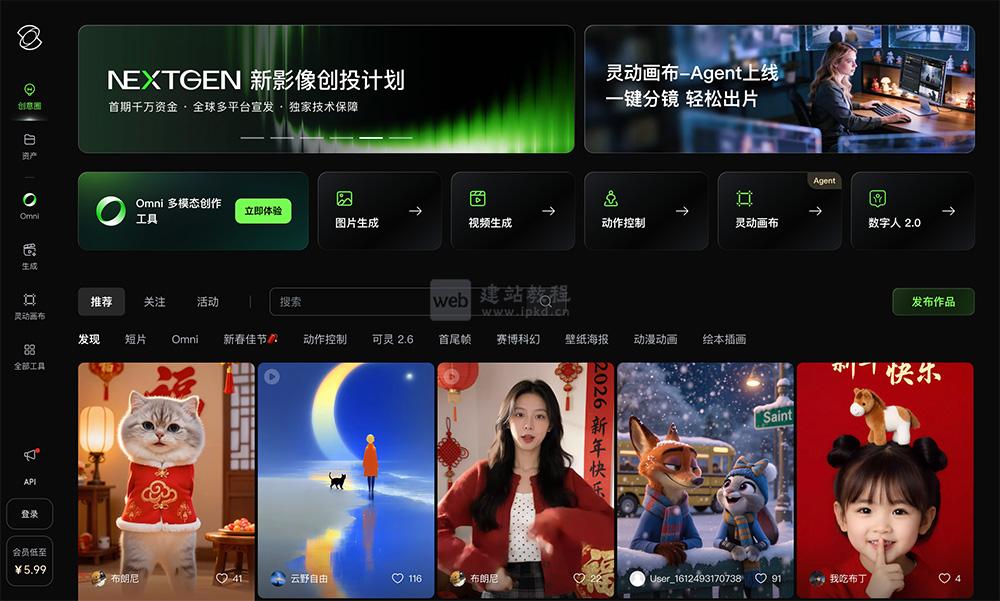

- 可灵AI 3.0:快手可灵AI推出的新一代多模态AI创作模型

本次更新包含四大核心版本:视频3.0新增AI智能分镜、15秒长视频、多语种及方言口型同步、图生视频主体参考;视频3.0 Omni强化全能参考与音色克隆能力;图片3.0支持10张参考图融合与自由编辑;图片3.0 Omni 提供2K/4K原生超清输出与批量组图创作。

- GLM-OCR:智谱AI开源轻量级多模态OCR模型0.9B参数登顶OmniDocBench SOTA

GLM-OCR是智谱AI开源的轻量级多模态OCR模型,模型基于GLM-V架构打造,集成智谱自研CogViT视觉编码器与轻量跨模态连接层,创新引入多Token预测损失和强化学习训练策略,在手写体、复杂表格、代码文档、印章、多语言混排等高难识别场景表现卓越。

- SkyReels-V3:昆仑万维开源多模态视频生成模型,专业级全模态视频创作

模型支持静态图像转动态影像、智能视频时长延长、电影级专业转场,更能实现数字人音视频精准同步,为创作者打造从短片段到长叙事的一站式视频生成解决方案,全方位适配商业创作、内容生产、行业应用等多元视频需求。

- MMBench:一款由高校等联合研发多模态基准测试工具

MMBench是一款多模态基准测试工具,由上海人工智能实验室、南洋理工大学、香港中文大学、新加坡国立大学及浙江大学联合研发。该基准构建了一套从感知到认知的逐级细分评估流程,覆盖20项细粒度能力维度,数据集包含约3000道单项选择题,均源自互联网及权威基准数据集。

- 可灵O1:可灵AI推出的全球首款统一多模态视频生成模型

可灵O1是可灵AI研发的全球首个统一多模态视频生成模型,模型支持图片、视频、文字等多模态输入,可一站式完成全能创作与编辑,精准解决视频生成中的主体一致性难题,解锁多元创意组合玩法。

- Gemini 3:谷歌推出的新一代旗舰级多模态AI模型与推理AI模型

用户可通过Google AI Studio、Vertex AI、Gemini CLI及全新智能体开发平台Google Antigravity调用Gemini 3;同时模型已打通Cursor、GitHub、JetBrains等第三方平台,为开发者提供灵活丰富的开发选择。