AI项目和框架

- [推荐] 豆包网页版:支持AI聊天,AI图片生成,AI漫画生成,AI写作等

字节跳动开发的一款多功能人工智能工具,基于云雀模型(豆包大模型)构建。它不仅是一个AI聊天机器人,还具备多种功能,包括写作助手、英语学习助手、音乐生成、编程助理等。

- OpenAI Academy:为教育工作者提供AI知识与实操技能培训

OpenAI Academy是一个面向教育者的免费AI教学赋能平台,平台通过K-12专属工作坊,深度解析生成式AI的技术架构、转型潜力及课堂实战应用,帮助教育者应对AI时代的机遇与挑战,在数字环境中为学生构建安全、自主的学习体验,赋能师生共创教育新未来。

- GPT-4.1:OpenAI推出的编码、指令跟随和处理长文本处理的新模型

OpenAI推出的GPT-4.1系列新模型,核心聚焦编码能力、指令跟随精度与超长文本处理三大维度的跨越式提升。模型将上下文窗口扩展至100万tokens,在真实场景中展现出卓越的实用性与稳定性,同时具备低延迟、低成本优势,助力开发者高效构建复杂应用,显著降低开发与运行成本。

- Voxtral Transcribe 2:支持13种语言、说话人分离、词级时间戳及上下文偏置功能

Voxtral Transcribe 2是Mistral AI推出的新一代语音转文本模型系列,包含两款定位差异化的核心版本,兼顾批量处理与实时交互场景,在准确率、性价比与多场景适配性上全面升级。其中,Voxtral Mini Transcribe V2聚焦批量转录需求,支持13种语言、说话人分离、词级时间戳及上下文偏置功能。

- OmniParser V2:微软研究院研发的GUI理解模型,提升准确性与效率

OmniParser V2主要面向开发者、企业研发团队、自动化测试工程师及AI应用厂商,尤其适合希望基于LLM构建智能GUI交互系统的团队。其核心价值在于提升GUI自动化的精度与效率、降低开发成本,并为终端用户提供更流畅的智能交互体验。

- Radar:涵盖关键词监控、趋势可视化等的社交媒体趋势分析高级工具

Radar是一款聚焦社交媒体趋势分析的高级搜索工具,核心功能涵盖关键词监控、趋势可视化、对话过滤与实时帖子计数统计,助力用户在信息爆炸的社交环境中快速捕捉高价值信息。

- Grok 3:马斯克旗下xAI公司推出的新一代旗舰级深度推理多模态AI模型

Grok 3是埃隆・马斯克旗下xAI公司推出的新一代旗舰AI模型,凭借算力升级与超大规模数据集支撑,实现复杂数学、科学问题的深度解析,全面支持多模态输入交互。其核心优势在于顶尖推理能力—— 能提供高精度答案,在多项权威基准测试中超越现有顶尖模型,标志着xAI在AI领域的突破性进展。

- Xcode 26.3苹果原生智能体编程,接入Claude Agent、Codex等模型

Xcode 26.3是苹果公司候选版推出原生智能体编程功能,接入Claude Agent、Codex等模型,通过MCP协议赋予AI工具调用能力,实现自动化编码、文档查阅与测试,同时以里程碑快照保障开发者控制权,降低开发门槛并提升效率。

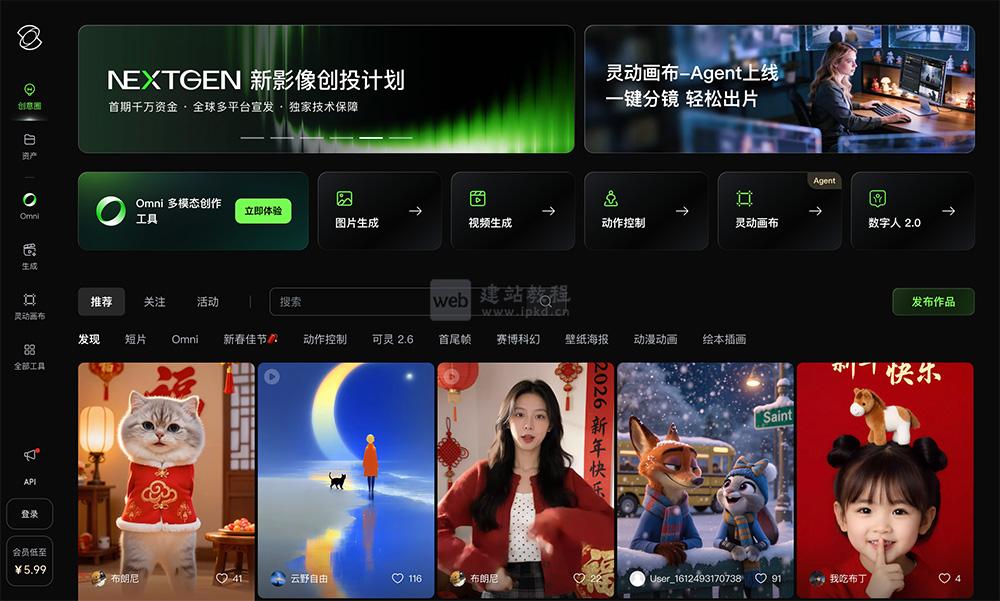

- 可灵AI 3.0:快手可灵AI推出的新一代多模态AI创作模型

本次更新包含四大核心版本:视频3.0新增AI智能分镜、15秒长视频、多语种及方言口型同步、图生视频主体参考;视频3.0 Omni强化全能参考与音色克隆能力;图片3.0支持10张参考图融合与自由编辑;图片3.0 Omni 提供2K/4K原生超清输出与批量组图创作。

- CL-bench:腾讯混元与复旦大学联合推出的Context学习能力评测基准

CL-bench是一个专注衡量大语言模型从全新上下文信息中实时学习、应用知识的核心能力。该基准包含500个专家精心构建的复杂场景、1899个任务,全面覆盖领域知识推理、规则系统应用、程序性任务执行和经验发现与模拟四大类别。

- MiniCPM-o 4.5模型:具备视觉理解、超拟人语音生成及声音克隆能力

MiniCPM-o 4.5是面壁智能开源的9B参数全模态旗舰模型,该模型具备领先的视觉理解、超拟人语音生成及声音克隆能力,支持主动交互与实时流媒体处理,可在端侧设备运行,已适配昇腾、海光等多种国产芯片,通过llama.cpp、vLLM等框架实现高效部署。

- ACE-Step 1.5:ACE Studio × StepFun联合开源商业级音乐生成基础模型

ACE-Step 1.5是ACE Studio × StepFun 联合开源基于混合架构设计,支持50+语言演唱、精细化风格控制及多维度音频编辑,通过少量歌曲LoRA微调即可实现个性化风格迁移,兼顾专业性、高效性与易用性。

- 玄武CLI:清昴智能开源国产大模型部署工具,国产芯片专属一键部署

玄武CLI(xw-cli)是清昴智能开源的国产大模型专属部署工具,针对华为昇腾、沐曦、燧原等国产芯片深度优化,依托自动硬件检测、智能引擎调度能力,实现零复杂配置一键启动模型服务。

- SoulX-FlashTalk:Soul App开源14B实时数字人生成模型,亚秒级延迟赋能商业级数字人应用

SoulX-FlashTalk是Soul App旗下AI团队开源的首款14B参数实时数字人生成模型,实现0.87秒亚秒级延迟、32fps高帧率输出,凭借双向流式蒸馏与多步自纠正核心机制,达成无限时长稳定生成、全身动作交互及多语言驱动能力。

- Qwen3-Coder-Next:阿里开源的MoE架构编程智能体模型

Qwen3-Coder-Next是一款专为编程智能体与本地开发设计的开源权重语言模型。该模型基于 Qwen3-Next-80B-A3B-Base 构建,采用混合注意力与 MoE 的新架构;通过大规模可执行任务合成、环境交互与强化学习进行智能体训练,在显著降低推理成本的同时,获得了强大的编程与智能体能力。

- Thinker:优必选开源具身智能视觉语言大模型 专为机器人场景打造

Thinker模型聚焦机器人核心需求,打造任务规划、空间理解、时间推理、视觉定位四大核心能力,精准解决机器人“想得到但抓不准”的行业痛点。模型基于20亿原始数据精炼的1000万高质量数据训练,依托自动化标注体系将人工参与率控制在1%以下,兼顾训练效率与数据质量。