AI项目和框架

- [推荐] 豆包网页版:支持AI聊天,AI图片生成,AI漫画生成,AI写作等

字节跳动开发的一款多功能人工智能工具,基于云雀模型(豆包大模型)构建。它不仅是一个AI聊天机器人,还具备多种功能,包括写作助手、英语学习助手、音乐生成、编程助理等。

- Alpamayo-R1:英伟达推出的自动驾驶视觉-语言-动作(VLA)模型

Alpamayo-R1是英伟达研发的视觉-语言-动作模型,模型核心创新涵盖三大维度:构建因果链(CoC)高质量推理轨迹数据集、采用具备物理常识与具身推理能力的Cosmos-Reason作为VLM骨干网络、设计“监督微调+强化学习”多阶段训练策略。

- HunyuanOCR:腾讯混元推出的开源轻量级端到端OCR视觉语言模型

HunyuanOCR是腾讯混元团队推出的开源端到端OCR视觉语言模型,其功能覆盖文本检测与识别、复杂文档解析、开放字段信息抽取、视频字幕抽取等经典OCR任务,同时支持端到端拍照翻译与文档问答,为多场景文本处理提供一站式解决方案。

- ViMax:香港大学数据科学实验室研发的端到端多智能体视频生成框架

ViMax是香港大学数据科学实验室研发的端到端多智能体视频生成框架,框架创新性整合导演、编剧、制片人及视频生成器的核心职能,支持Idea2Video、Novel2Video、Script2Video、AutoCameo四大生成模式。

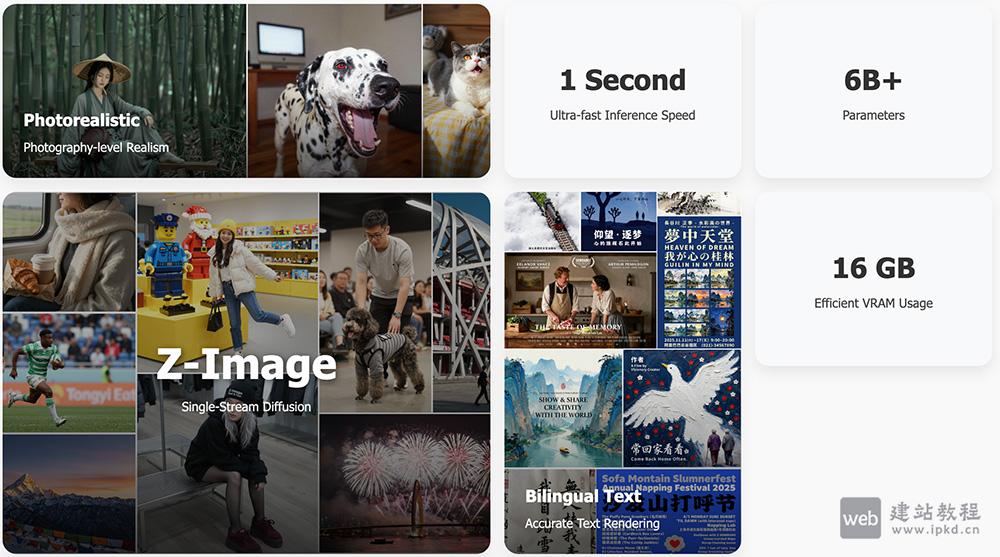

- Z-Image:阿里通义6B参数轻量化多模态图像生成模型

Z-Image是阿里通义推出的6B参数轻量化图像生成模型,构建单流DiT架构核心底座,衍生出三大功能变体:Z-Image-Turbo、Z-Image-Base、Z-Image-Edit,精准匹配不同场景需求。

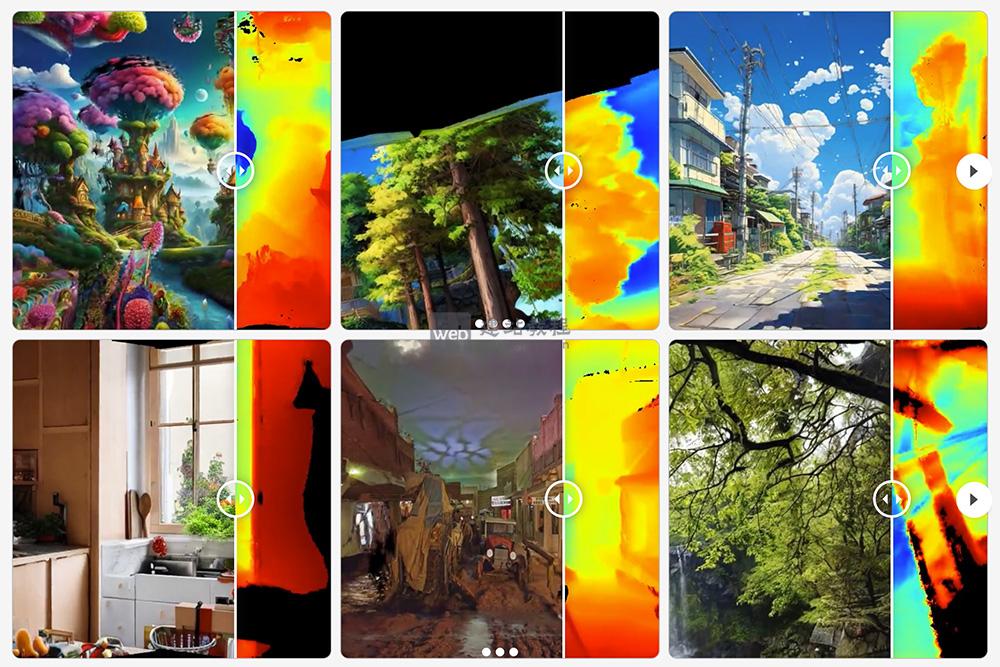

- Argus 1.0:如视推出的全球首个支持全景图输入的空间大模型

Argus 1.0是如视推出的全球首个支持全景图输入的空间大模型,该模型具备毫秒级实时重建能力,可从全景图或普通照片中快速推理相机位姿、深度图与点云图,生成高精度三维空间模型;同时具备极强的多源输入适应性,兼容多种图像类型,生成的3D空间质量显著优于同类方案。

- FrogBoss模型:微软研究院推出的高性能编程智能模型

FrogBoss是微软研究院研发的系列编程智能模型,核心依托创新的复杂漏洞生成方法BugPilot完成训练。该方法通过让大语言模型代理(LLM)在代码库中添加新功能的过程中“无意引入漏洞”,生成更贴近真实开发场景、更具挑战性与多样性的训练数据。

- HunyuanVideo 1.5:腾讯混元团队推出的开源轻量级视频生成模型

HunyuanVideo 1.5是腾讯混元团队推出的开源轻量级视频生成模型,模型支持文生视频、图生视频双模式生成5-10秒高清内容,具备强大的指令理解能力,可精准复刻写实、动画等多元视觉风格。

- InfinityStar:字节跳动推出的高效开源视频生成模型

InfinityStar是字节跳动推出的高效视频生成模型,该模型支持文本到图像、文本到视频、图像到视频及长时间交互视频合成等多类任务,且所有代码与模型均已开源。

- DPAI Arena:JetBrains与Linux基金会联合推出的AI编码智能体基准测试平台

DPAI Arena是JetBrains携手Linux基金会打造的开放式AI编码智能体基准测试平台,平台创新性采用多轨道架构,覆盖问题修复、PR审查、测试生成等真实开发场景,构建起透明、可扩展的评估体系。

- WeatherNext 2:谷歌DeepMind与Google Research联合研发的新一代AI天气预报模型

WeatherNext 2是谷歌DeepMind与Google Research联合推出的新一代AI天气预报模型,核心采用创新的Functional Generative Network(FGN)函数生成网络架构,实现运算效率与预报精度的双重突破——运算速度较前代提升约8倍。

- Skywork R1V4-Lite:昆仑万维推出的轻量级多模态智能体

Skywork R1V4-Lite是昆仑万维推出的轻量级多模态智能体,该模型无需人工设计提示词,用户仅需上传一张图片,即可自动完成观察、推理、决策并输出答案;同时支持图像裁切、放大、旋转等主动操作,结合联网搜索能力构建“搜索—推理—验证”闭环,高效解决复杂多模态任务。

- Gemini 3:谷歌推出的新一代旗舰级多模态AI模型与推理AI模型

用户可通过Google AI Studio、Vertex AI、Gemini CLI及全新智能体开发平台Google Antigravity调用Gemini 3;同时模型已打通Cursor、GitHub、JetBrains等第三方平台,为开发者提供灵活丰富的开发选择。

- Kosong:月之暗面(Moonshot AI)推出的开源轻量级AI Agent开发框架

Kosong是月之暗面推出的开源轻量级AI Agent开发框架,框架核心搭载异步工具编排引擎,可高效调度多工具并行执行——例如同时调用天气API、地图服务与日历系统,大幅提升智能体的响应效率与任务完成率。

- GPT-5.1:OpenAI推出的GPT-5系列AI智能升级版本

GPT-5.1是OpenAI对GPT-5系列的迭代升级版本,该模型包含两个差异化版本:GPT-5.1Instant和GPT-5.1Thinking。其中Instant版本更温暖自然,适配日常对话场景,能精准遵循指令并输出有趣回答。